AI最前线:面向人群计数场景的感知对抗补丁

责编:gltian |2022-10-08 14:47:59

近年来,人工智能的飞速发展也引发了人们对该领域安全性的广泛关注,在许多领域,人工智能产品安全将直接关乎人类社会公共安全。最近,来自北京航空航天大学、约翰霍普金斯大学等机构的研究人员发现,用于监控人流密度的AI自动人群计数系统同样存在安全隐患。

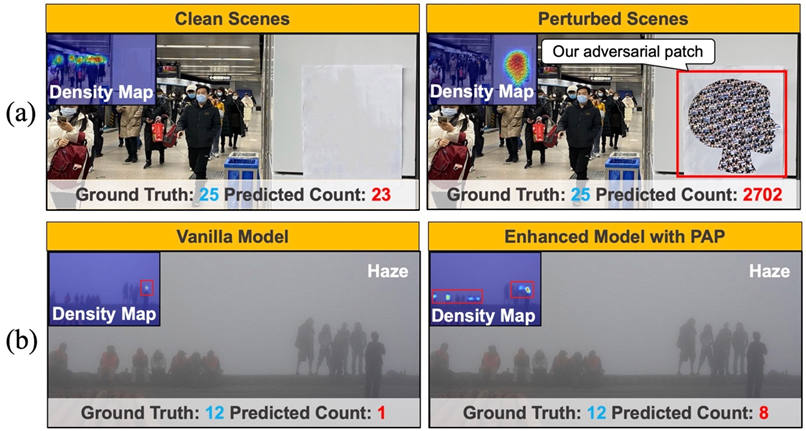

研究者们提出了一种基于模型感知特性的对抗补丁生成框架(PAP),生成微小的对抗贴纸便可轻松导致基于密度图估计的人群计数模型(下文简称人群计数模型)识别崩溃(下图(a))。数字世界和真实世界的大量实验证明了这种对抗补丁的强攻击性。进一步,研究者利用设计的感知对抗补丁进行对抗训练,发现可以一定程度提升模型在原任务场景下对未知人群尺度的泛化能力和对复杂背景的鲁棒性(下图(b))。

尺度感知特性&位置感知特性

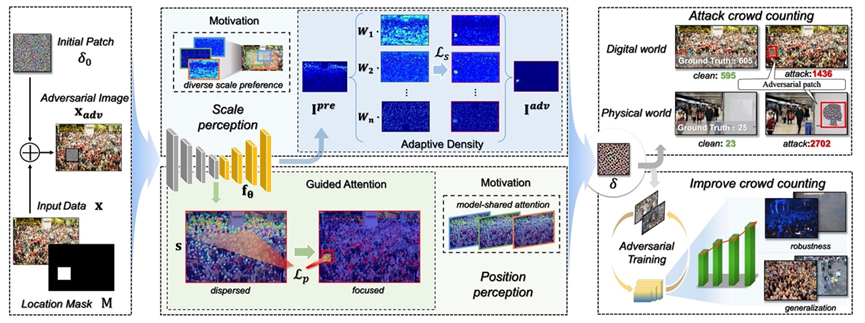

对于真实场景,由于我们事先无法知晓被攻击系统的模型信息,并且考虑到访问权限等问题,论文采用了基于对抗样本迁移的黑盒攻击方法。因此,对抗补丁的黑盒迁移能力决定了其在真实世界中应用的攻击能力。与先前的研究工作不同,论文从人群计数模型的特有感知属性角度,设计提升对抗补丁攻击迁移性的策略。论文观察到了人群计数模型的两个潜在感知特性,即尺度感知与位置感知,如下图所示。

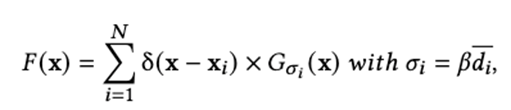

对于尺度感知,人群计数模型往往采用不同的分支结构来捕获不同程度的人群尺度特征。图中展示了MCNN模型的3个不同分支捕获的特征图和6种常见人群计数模型的预测密度图,可以看到,不同结构的模型因感受野等差异导致存在一定程度的尺度偏好。常规的优化方法将容易导致对抗补丁拟合到特定的尺度信息上,从而降低其泛化能力。因此,论文提出基于密度权重的自适应尺度感知模块,通过动态调节补丁优化过程中不同尺度的比重来增强对抗补丁的尺度感知不变性。

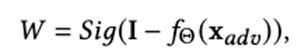

对于位置感知,通过基于人群密度的Grad-Cam方法,论文发现不同的人群计数模型拥有相似的注意力模式。在识别人群的过程中,模型注意力总是呈分散状落在人头区域。基于此,论文通过将模型共享的注意力区域汇聚到补丁所在位置,从而使对抗补丁在优化中捕获位置感知不变特征,进一步增强其攻击迁移能力。

感知对抗补丁生成框架

基于人群计数模型的尺度和位置感知特性,论文提出了一种感知对抗补丁生成框架,如下图所示。在基本的对抗补丁优化框架中,引入基于自适应密度权重的尺度感知模块和基于导向注意力的位置感知模块,用于提升对抗样本的黑盒迁移能力。生成的对抗补丁既可以实现高强度攻击,又可以被用来作为增强数据提升模型的泛化性和鲁棒性。下面分别介绍两个感知模块的设计方案。

基于自适应密度的尺度感知

人群计数领域的研究指出,对于视野中不同尺度的人群感知是目前的难点之一。已有的深度学习模型对于多尺度特征的捕获是不完备的,不同的人群计数模型在密度预测结果中呈现出一定程度的尺度偏好。因此,高迁移性要求对抗补丁在多种尺度特征下均具有攻击能力。为达成这一目标,论文引入了自适应密度权重机制。

首先,参考人群计数工作的一般处理方式,对于输入的图像x,我们通过几何自适应的高斯核对其进行处理来获得密度图的真值I。

通过使用高斯核平滑每个人的头部标注信息,真值密度图I考虑了输入图像的空间分布,因此可认为其包含场景的全部人群尺度信息。基于此,论文提出密度权重矩阵W如下。

对于每次迭代,可以通过比较真实值和预测值来更新W。显然,对于某一尺度的人群区域,其在真值密度图当中会呈现出高值,而模型若没有感知到该人群区域,即预测密度图中该区域没有高值,则该区域将被赋予更大的权重。换句话说,通过权重W可以强化源模型中感知薄弱的特征,这将有助于补丁更好地捕获它们。之后,将权重乘到预测密度图当中并逐像素点累加得到赋权的预测人群数作为尺度感知损失。

通过优化该损失,对抗补丁可以更好捕获尺度不变特征从而更好适应不同模型的尺度感知偏好,进而提升攻击迁移性。

基于导向注意力的位置感知

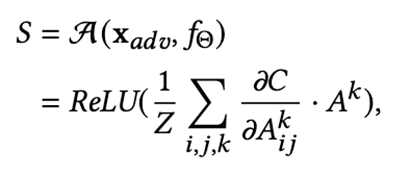

Grad-Cam作为模型可解释的方法之一,可以有效归纳模型决策的依据。受其启发,论文设计了密度引导的模型注意力提取方法,以帮助对抗补丁捕获位置不变特征并干扰位置感知。具体来讲,对于输入x,可以通过以下模块提取注意力图S,其中C表示预测人群数。

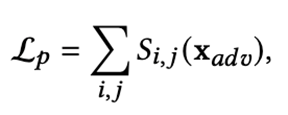

为了成功攻击人群计数模型,论文将模型的注意力吸引到对抗补丁上,从而分散它对于人群的注意力。论文引入如下的位置感知损失,其为注意力图的像素值加和。

因此,具有相似关注区域的不同模型将聚焦于对抗补丁,并做出错误的预测。

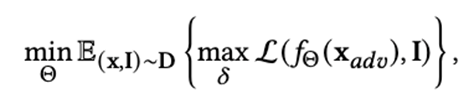

综上所述,整体优化目标为联合优化尺度与位置感知损失。论文考虑了正向攻击(预测人群数增多)与负向攻击(预测人群数减少)两种形式。对于前者,优化目标为联合损失最大,如下式,

对于负向攻击,仅需最小化联合损失即可。

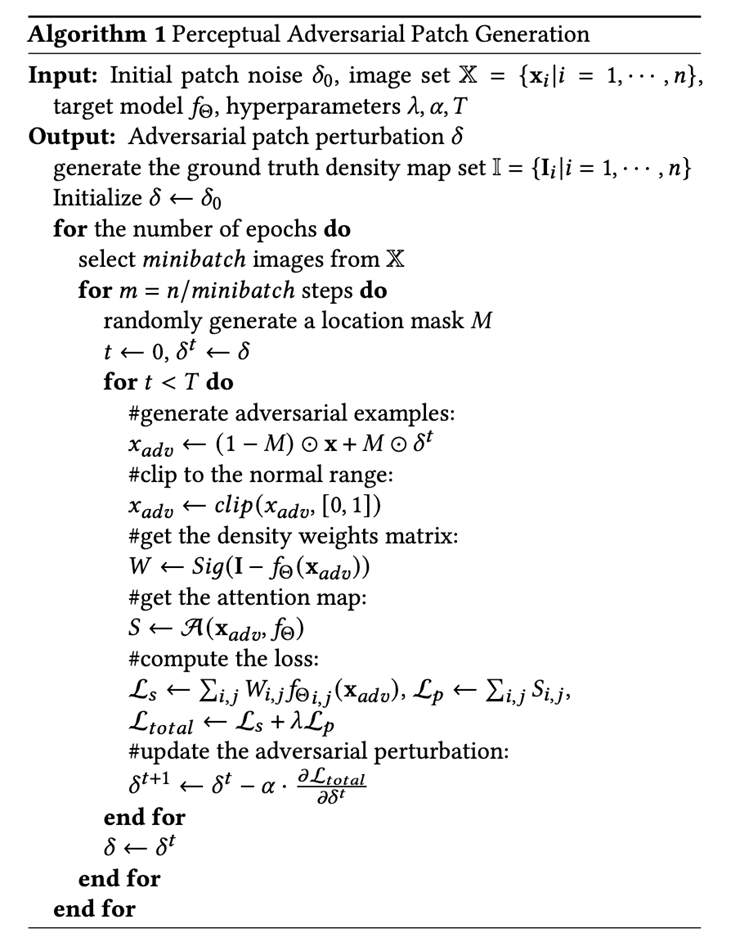

整体算法框架的训练流程如下图:

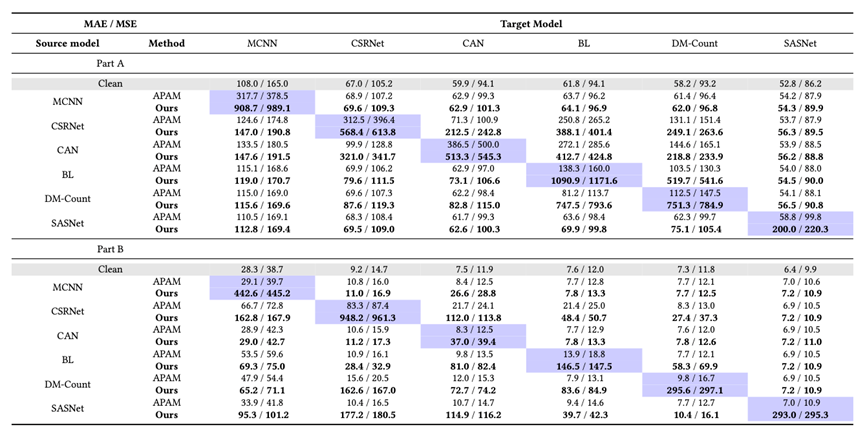

数字世界攻击实验

论文在Shanghai Tech数据集上进行了数字世界攻击实验。数据集分为Part A与Part B两部分,两者由于采集环境的不同呈现不同的分布。论文选用了6个常用人群计数模型,并采用平均绝对误差与平均平方误差作为衡量指标。首先,论文与之前的人群计数对抗攻击算法APAM进行了比较,结果如下所示。

实验证明论文提出的方法无论是白盒还是黑盒表现均优于对比算法。

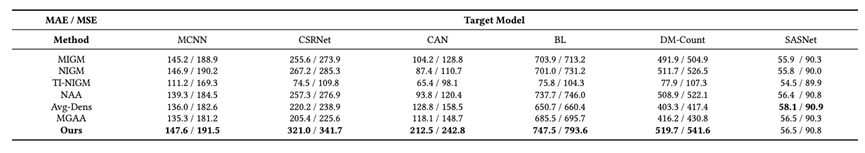

除此之外,论文还与其他迁移攻击算法进行了比较。如下所示,实验证明除在SASNet上的表现稍差于集成攻击方法外,PAP攻击效果均超过其他算法。

物理世界攻击实验

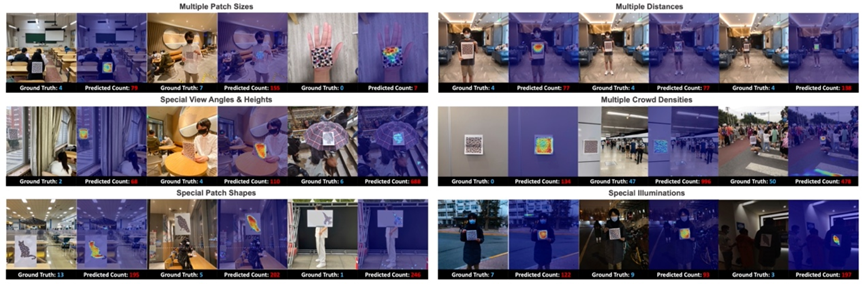

在物理世界实验中,论文考虑了补丁尺寸、距离、角度、形状、光照等多种真实世界条件变化的影响。多种场景下共采集110张实验图像用于黑盒验证,实验结果如下图所示。

可以看到,生成的对抗补丁在真实环境下仍然具有很高的攻击性。

除此之外,论文中对于两种感知损失进行了消融验证,并探讨了超参、补丁形状、数据集、对抗防御策略等对于算法性能的影响,分析了负向攻击效应,感兴趣的朋友可以查看原论文。

对抗训练提升原任务性能

研究者认为,对抗样本除具备强大的攻击能力以外,还可作为特殊的增强数据用于提升原任务的表现。基于此,论文采用了标准的对抗训练框架,如下式。

由于感知对抗补丁可以攻击不同人群尺度感知下的模型,并干扰它们聚焦于错误的位置感知区域。因此,使用对抗补丁进行对抗训练,可以进一步增强模型对尺度和位置扰动的容忍度。换言之,使用感知对抗补丁增强的人群计数模型可以提升对多人群尺度的感知泛化,并通过更好地关注噪音下的人群本身来纠正位置感知偏差。因此,它将更好地应用到具有未知人群尺度的场景,并更加关注人群区域,而不是自然场景中的复杂环境背景。

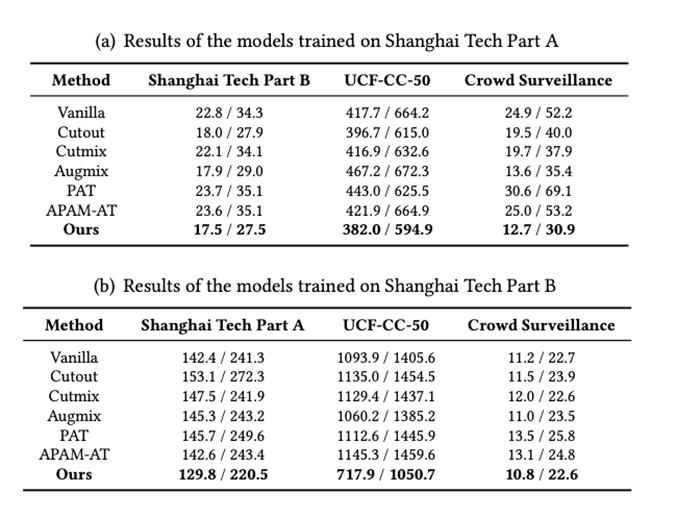

论文与数据增强以及不同扰动形式的对抗训练方法进行了实验比较。泛化性实验结果如下,可以看到论文提出的感知对抗补丁训练方法可以有效提升模型跨数据集的泛化能力。

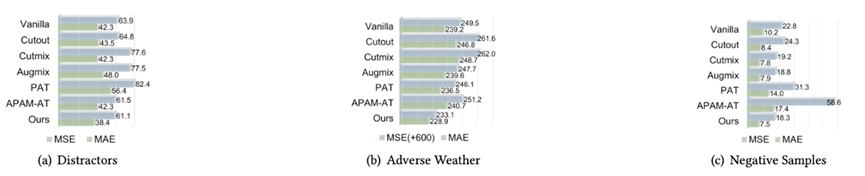

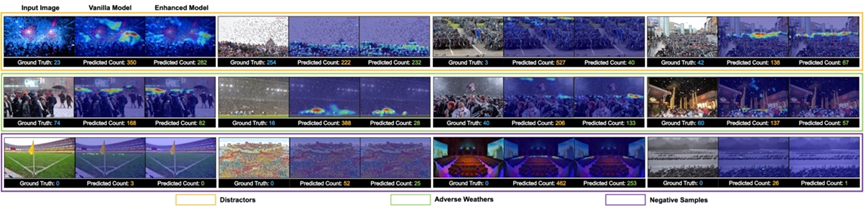

论文在具有类人群干扰物的样本、恶劣天气样本以及无人群负样本上验证了模型对复杂背景的鲁棒性。实验结果如下:

可以看到,原始模型的密度图上突出显示了许多非目标区域,而增强模型对这些干扰因素更为鲁棒。使用PAP训练的模型可以更准确地关注人类区域,因此增强模型预测的人数更接近实际情况。

总结与展望

对抗攻击作为一种发现AI安全漏洞的有效方法,迫使研究人员更加关注模型的鲁棒性。本文提出感知对抗补丁生成框架(PAP),利用模型尺度感知和位置感知来学习模型不变特征,从而提升对抗补丁的攻击迁移性。数字和物理世界大量实验表明PAP达到了最先进的性能。通过攻击,研究者发现在回归任务上现有的对抗防御策略并非无懈可击。此外,值得进一步探讨如何有效地定义人群计数这类回归任务的鲁棒性性度量指标。

此外,这种攻击策略可以起到隐私保护的作用。通过破坏恶意监视系统来保护人群信息,从而防止公众合法集会的权利被侵犯。在这种场景下,仍有许多障碍需要克服,例如如何使对抗补丁看起来足够自然,如何有效地覆盖所有被观测区域等。尽管本工作建议在衣服或海报上印贴补丁,但研究者期望更有效的补丁生成方法来防止人类感知带来的异常警告。

从另一个角度来看,我们期望自动人群计数模型具有强大的通用性,以应对不断变化的真实状况。然而,现有的深度学习方法存在过拟合已知数据分布的问题。与大多数之前的研究相比,论文惊奇地发现,使用对抗补丁进行对抗性训练可以提升模型原任务的泛化性能,揭示了对抗攻击技术向善的一种可能。虽然论文中提供了初步的解释,但研究者认为该性质和机制值得未来进一步研究。

论文信息

该论文已被全球安全领域顶级会议 ACM Conference on Computer and Communications Security (ACM CCS) 2022接收。

Shunchang Liu, Jiakai Wang, Aishan Liu, Yingwei Li, Yijie Gao, Xianglong Liu, Dacheng Tao. Harnessing Perceptual Adversarial Patches for Crowd Counting. ACM CCS, 2022.

代码链接:https://github.com/shunchang-liu/PAP-Pytorch

撰稿:刘艾杉,北京航空航天大学计算机学院助理教授

邮箱:liuaishan@buaa.edu.cn

个人主页:http://scse.buaa.edu.cn/info/1080/8731.htm

来源:隐者联盟